作为数码艺术项目和热门自拍软件,图网轮盘(ImageNet Roulette)暴露了偏见如何渗入正改变我们生活的人工智能技术。

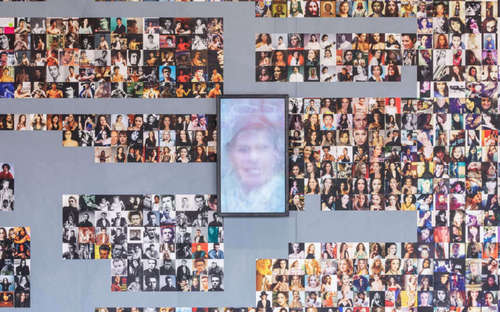

2019年9月12日,“训练人类”摄影展在米兰的普拉达基金会艺术展览馆揭幕。该展览展示了如何训练人工智能系统,使其得能够“看见”世间万物并对其归类

当塔邦·基马(Tabong Kima)在周三清晨刷新推特时,当前的热议话题是图网轮盘。似乎每个人都把自己的自拍照上传到名为“图网轮盘”的网站,该网站可以用某种人工智能(AI)分析上传照片的人脸,并对其进行文字描述。一名男性就被打上了“孤儿”的标签,另一个则是“非吸烟者”,还有一个戴眼镜的则被描述为“学痴、宅男、书呆子、工作狂、怪咖”。

在给基马先生推送的推特信息里,这些有的准确、有的奇怪、有的毫无根据的标签看起来只为博人一笑,于是他也加入其中,可24岁非裔美国人的基马先生并不喜欢他看到的结果:当上传了自己的微笑照片后,网站给他贴上的标签是“滋事者”和“寻衅者”。

基马先生在他的推特里写道:“我可能没啥幽默感,不过我真不觉得这个好笑。”

事实证明,他的反应正是该网站的目标。图网轮盘是一个数字艺术项目,旨在揭示那些古怪、不健全和令人反感的行为,这些行为可能渗透到快速改变我们日常生活的人工智能技术中,包括互联网公司、警察部门和其他政府机构使用的面部识别服务。

人脸识别和其他AI技术通过分析海量数据来习得自身的技能。这些数据来自旧的网站和学术研究项目,通常会含有多年来一直忽视的微妙偏见和其他瑕疵。由美国艺术家特雷弗·帕格伦(Trevor Paglen)和微软研究员凯特·克劳福德(Kate Crawford)设计的“图网轮盘”的初衷就是为了显示这个问题的深度。

身处巴黎的帕格伦在接受电话采访时说:“我们希望展示不同层面的偏见、种族主义和厌女症如何在不同系统中传递,关键在于要让人们看到幕后工作是如何进行的,要让他们看到一直以来我们的信息是如何处理和分类的。”

2019年9月12日,“图网轮盘”作为展览的一部分在米兰的普拉达基金会艺术馆揭幕,其针对的主要是一个名为“图网”(ImageNet)的大型可视化数据库。十多年前,斯坦福大学的一组研究人员首次编写了“图网”,随后“图网”在深度学习(机器学习的一个子领域,一种能够让机器识别包括人脸在内的图像的数学方法)的崛起中扮演了极为重要的角色。

“图网”拥有从互联网上收集的超过1 400多万张照片,是用来训练AI系统和评价其准确性的工具。通过分析各种各样的图像(例如花、狗和汽车的照片),这些AI系统学会如何去识别它们。

但在研究AI的群体里,人们鲜有提及的是:图网同时也包含了成千上万个人的照片,并且每张照片都进行了分类。这包括像“啦啦队队员”“电焊工”和“童子军”这样直白的标签,也包括像“残次品、失败者、无望成功、碌碌无为”和“臭女人、荡妇、邋遢女、婊子”这种含有强烈情感色彩的标签。

不管这些标签看上去是否无伤大雅,通过搭建运用这些标签的艺术项目,帕格伦先生和克劳福德女士展示了人的观念、偏见和有时候很冒犯人的观点是如何驱动人工智能的产生。

图网的分类标签被数千个不知身份的人应用,这些人大多数身处美国,受雇于斯坦福研究团队,他们通过劳务众包平台“亚马逊土耳其机器人”(Amazon Mechanical Turk,简称AMT)标注照片,按张计费,能在1小时内标注上千个标签。随着他们对照片的标注,偏见就这样融入数据库。尽管我们无从得知这些进行标注的人是否带有这样的偏见,但正是这些人定义了“失败者”“荡妇”还有“滋事者”。

这些标签最初来源于另一个名为“词网”(WordNet)的庞大数据库,这是由普林斯顿大学研究人员在20世纪80年代为机器建立的概念词典。但是,随着那些具有煽动性的标签被收入其中,斯坦福大学的研究人员可能并没有意识到他们在做什么。

人工智能常常用海量的数据集来进行训练,即使它的制造者可能并不十分清楚这些数据集有哪些内容。“这样的事情在宏观尺度上时有出现,而这会导致系列后果。”在人工智能初创公司克拉里法伊(Clarifai)负责数据标注监督的利兹·奥沙利文(Liz O’Sullivan)说道。他现在是名为“监控技术监管项目”的民权和隐私组织的成员,该项目旨在提高人们对AI系统问题的认识。

图网数据集中使用的许多标签都是极端的,但同样的问题也会出现在看似并不具有冒犯性的标签中,毕竟用什么来定义“男性”或“女性”目前仍有争议。

奥沙利文解释道:“当在对女性或女孩的照片进行标记时,人们可能并不会将非二元性别者或短发女性归于此;于是你获得的AI模型就只会含有长发女性的数据。”

近几个月来,研究人员向世人展示了:由像亚马逊、微软和IBM等公司提供的人脸识别服务会对女性和有色人种存有偏见。帕格伦先生和克劳福德女士希望通过这个项目能够引起人们对这个问题的更多关注——他们的确做到了。在笔者撰文的这周内,随着该项目在推特等网站逐渐流行,图网轮盘一度在

1小时内生成了超过10万个标签。

克劳福德女士评论说:“这个项目能够像现在这样成功,这对我们来说完全是个惊喜; 这能让我们真正看到人们对这个项目的看法以及让人们真正参与其中。”

对于有的人来说,这就是个玩笑,但对于其他像基马先生这样的人,则接收到了项目想要传达的信息。“在展示存在什么问题方面,他们做得很好;而在我意识到这个问题之前的那个阶段就有点糟糕了。”基马先生评价道。

尽管如此,帕格伦先生和克劳福德女士认为,问题可能比人们意识到的还要严重。

很多数据集已经反复被科技巨头、初创企业和学术实验室用来训练各种人工智能,而图网只是其中之一。这些数据集的任何瑕疵都已经广泛传播。

如今,许多公司和研究人员正在努力消除这些瑕疵。为了应对关于偏见的投诉,微软和IBM已经升级了他们的人脸识别服务。2019年1月,差不多在帕格伦先生和克劳福德女士首次探讨图网中使用奇怪标签的同一时间,斯坦福大学的研究人员已经禁止了图网数据集中所有人脸数据的下载,并在近期宣布他们将删除大量人脸数据。该团队发布在《纽约时报》上的声明表示:他们的长期目标是“解决数据集和算法的公正性、可靠性和透明性”。

但对帕格伦先生而言,更大的问题浮出了水面。AI最基础的本质是向人类学习,而人类就是有偏见的生物。他说:“我们对图像进行分类的方式是我们世界观的产物,任何类型的分类系统都会反映进行分类操作的人的价值观。”

资料来源 The New York Times

_______________

本文作者卡德·梅茨(Cade Metz)是《纽约时报》科技专栏作者,撰文涵盖人工智能、无人驾驶汽车、机器人、虚拟现实和其他新兴领域。